| Mówi: | Michał Boni |

| Funkcja: | adiunkt na Uniwersytecie SWPS, były minister cyfryzacji |

M. Boni: Potrzebujemy planu wdrożenia nowego aktu o sztucznej inteligencji. To może być zadanie polskiej prezydencji w UE

W środę 13 marca Parlament Europejski zatwierdził AI Act. To pierwsza tego typu regulacja tak szeroko obejmująca obszar sztucznej inteligencji. Celem nowych przepisów jest zbudowanie środowiska prawnego, które pozwoli na rozwój tej technologii, przy jednoczesnym poszanowaniu praw podstawowych, ochronie demokracji czy praworządności przed systemami wysokiego ryzyka. – Przy wielu artykułach, które niekoniecznie są interpretowalne łatwo i w spójny sposób, proponowałbym, żeby Komisja Europejska, ale to może być też polska rola podczas prezydencji, przygotowała plan wdrożenia regulacji o sztucznej inteligencji – ocenia były minister cyfryzacji Michał Boni.

Artificial Intelligence Act przewiduje m.in. skategoryzowanie zakazanych praktyk w zakresie rozwiązań AI, szczególnie tych, które zagrażają prawom obywateli. Zaliczono do nich m.in. używanie technik podprogowych oraz dyskryminujących, manipulujących zachowaniem ludzi lub wykorzystujących ich słabości Nowe przepisy zakażą stosowania systemów sztucznej inteligencji w zakresie tzw. social scoringu, czyli klasyfikacji punktowej obywateli. Ograniczą także korzystanie z systemów identyfikacji biometrycznej dla organów ścigania – w tym przypadku przewidują pewne wyjątki, które wąsko zdefiniowano na zamkniętej liście. Ponadto będzie obowiązek wyraźnego oznaczania nieautentycznych lub zmanipulowanych obrazy, treści audio lub wideo.

– Trzeba zacząć od tego, że sztuczna inteligencja sama w sobie nie jest ani zła, ani dobra, jest neutralna. Zastosowania sztucznej inteligencji mogą być różnorakie i to często zależy od ludzi, państw i firm. Regulacje są potrzebne do tego, żeby zanalizować ryzyka, które mogą przynieść konkretne zastosowania sztucznej inteligencji – mówi agencji Newseria Biznes Michał Boni, adiunkt na Uniwersytecie SWPS, były minister cyfryzacji.

Kluczowa będzie ocena takiego ryzyka i potencjalnego wpływu na bezpieczeństwo obywateli.

– Jeśli te ryzyka są zbyt duże, to być może powinno być ograniczenie wprowadzania w życie danego rozwiązania, a jeśli są mniejsze, ale jakieś są jednak, to wtedy firma powinna przejść test sprawdzający, czy te ryzyka wpłyną na ludzi, społeczeństwo, środowisko zewnętrzne – mówi Michał Boni. – Takie testy zostały przygotowane przez grupę ekspertów zajmujących się m.in. etycznymi wymiarami sztucznej inteligencji. Więc to jest do okiełznania, tylko musimy podejść praktycznie od strony zastosowań i ryzyk, a nie od mówienia generalnego o sztucznej inteligencji.

W AI Act określono szczególne obowiązki dla systemów wysokiego ryzyka. Obszary, w których są one wykorzystywane, to m.in.infrastruktura krytyczna, edukacja i szkolenie zawodowe, zatrudnienie, podstawowe usługi prywatne i publiczne (np. opieka zdrowotna, bankowość). Opierają się też na nich niektóre systemy organów ścigania. Wykorzystuje się je, by zarządzać migracją i granicami oraz na potrzeby wymiaru sprawiedliwości i procesów demokratycznych, np. wyborów. Takie systemy muszą oceniać i ograniczać ryzyko oraz prowadzić rejestry zdarzeń. Muszą też być przejrzyste i dokładne oraz podlegać kontroli przez człowieka. Dodatkowo obywatele zyskają prawo do złożenia skargi dotyczących systemów SI.

Jak podkreśla ekspert, wyzwaniem przy tworzeniu tego typu aktów prawnych jest uniwersalność poszczególnych zapisów. Chodzi o to, by miały one zastosowanie także w przyszłości wobec nowych ryzyk, które nie są znane. Stąd wiele zapisów może wydawać się niejasnych.

– Przy wielu artykułach, które niekoniecznie są interpretowalne łatwo i w spójny sposób, ja bym proponował, żeby Komisja Europejska, ale to może być też polska rola podczas prezydencji, przygotowała ważny dokument, czyli plan wdrożenia regulacji o sztucznej inteligencji. To jest skomplikowane, bo niektóre rzeczy z tego aktu będą wchodziły w kilka miesięcy po przyjęciu, inne w rok, inne w półtora, inne w dwa lat, do trzech, więc to będzie trwało. Po to, żeby to było sensownie zrobione, to taki plan wdrażania powinien być przygotowany – ocenia Michał Boni. – Tam, gdzie różne rzeczy nie będą do końca jasne, powinniśmy pójść w stronę kodeksu dobrych praktyk. Czyli biznes między sobą powinien ustalać, razem z innymi partnerami, np. użytkownikami, jakie rozwiązanie jest dobre i trzyma się ducha prawa o sztucznej inteligencji, które między innymi ma chronić naszą podmiotowość.

Według firmy doradczej Deloitte, postępująca cyfryzacja gospodarki sprawia, że kolejne organizacje decydują się na zastosowanie narzędzi opartych na sztucznej inteligencji. Z raportu „Unlocking the power of AI” wynika, że ponad 90 proc. firm chce osiągnąć wyższy poziom dojrzałości w zakresie AI w trakcie najbliższych trzech lat. Tempo i realizacja ich planów jest jednak uzależniona od takich czynników jak: kwalifikacje personelu oraz zdolności danej organizacji do wdrożenia rozwiązań opartych na uczeniu maszynowym. Autorzy przytoczonego raportu szacują, że w ciągu dwóch najbliższych lat biznesowa wartość, która powstanie dzięki AI, może wynieść nawet 4,4 bln dol.

Wiele środowisk na etapie tworzenia nowego prawa wyrażało obawy, że wprowadzenie wspomnianych regulacji może spowolnić rozwój rynku sztucznej inteligencji. Takiej oceny nie podziela Michał Boni.

– Myślę, że rynek będzie się tak samo dynamicznie rozwijał jak teraz, dlatego że wiele firm już stosuje te zasady, mechanizmy, choćby analizy ryzyka, które są wpisane do tej regulacji. Natomiast na pewno będzie potrzebne dobre doradztwo, szczególnie dla małego biznesu, jak niektóre przepisy zinterpretować, ale też przede wszystkim, czy te zastosowania sztucznej inteligencji, które chcą wprowadzić, jakąś predykcję, przewidywanie w oparciu o dane tego, co z biznesem się może dziać, czy to tworzy jakieś ryzyka, czy nie – mówi były minister cyfryzacji. – W wielu wypadkach nie będzie w ogóle tworzyło żadnego ryzyka. Pamiętajmy, że ta regulacja wskazuje na systemy o wysokim poziomie ryzyka, ale jest ich między 10 a 15 proc. 85 proc. systemów sztucznej inteligencji funkcjonuje bez żadnego ryzyka, więc tu nie będzie jakiejś radykalnej, powszechnej zmiany.

Unijne rozporządzenie przewiduje powstanie Europejskiej Rady ds. Sztucznej Inteligencji. Ponadto w państwach członkowskich mają powstać organy krajowe zajmujące się tym zagadnieniem. Główne zadanie tych instytucji będzie skoncentrowane na skutecznym egzekwowaniu zapisów rozporządzenia w każdym z państw UE. Na poziomie krajowym będą powstawać również tzw. piaskownice regulacyjne. Ich celem będzie ułatwienie firmom rozwijania innowacji oraz przeprowadzania testów nowych rozwiązań przed oddaniem do użytku.

Sztuczna inteligencja to pojęcie bardzo szerokie, które w ujęciu teoretycznym pojawiło się w nauce już w 1956 roku za sprawą amerykańskiego informatyka Johna McCarthy’ego. Z czasem definiowano ją jako zdolność systemu do właściwej interpretacji danych, które pochodzą z różnych zewnętrznych źródeł, a także automatycznego uczenia się na podstawie zebranych informacji, a następnie wykonywania określonych zadań. Obecnie pojęcie „sztucznej inteligencji” jest wiązane z różnymi popularnymi rozwiązaniami w zakresie automatycznego tworzenia tekstów, grafik, tłumaczeń czy materiałów audiowizualnych. W rzeczywistości to dużo szersze pojęcie dotykające m.in. takich obszarów jak sieci neuronowe, uczenie maszynowe, przetwarzanie danych (w tym Big Data), rozpoznawania obrazów, dźwięków czy mowy, a także sztucznej twórczości.

Czytaj także

- 2025-07-16: Przedstawienie projektu przez KE oznacza początek dyskusji nad nowym siedmioletnim budżetem. W PE zdania co do jego kształtu są podzielone

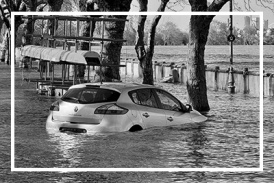

- 2025-07-25: Kraje dotknięte powodzią z 2024 roku z dodatkowym wsparciem finansowym. Europosłowie wzywają do budowy w UE lepszego systemu reagowania na kryzysy

- 2025-07-14: W tym tygodniu Komisja Europejska przedstawi projekt budżetu na lata 2028–2034. To będzie pierwsza długoletnia perspektywa czasu wojny

- 2025-07-14: Parlament Europejski wzywa do większej ochrony wolności dziennikarzy. Wiceprzewodnicząca: media mają pełnić funkcję kontrolną, a niektórym rządom to się nie podoba

- 2025-07-22: Przemysł chemiczny czeka na szczegóły unijnego wsparcia dla sektora. Najważniejsza jest obniżka cen energii

- 2025-06-24: Bezpieczeństwo stało się w UE tematem numer jeden. Miała w tym udział polska prezydencja

- 2025-07-10: Nowy raport KE wskazuje pewną poprawę w zakresie praworządności w Unii. Parlament chce silniejszych instrumentów do jej ochrony

- 2025-07-07: Trwa debata o nowych przepisach dotyczących praw pasażerów. Możliwe zmiany w wysokości odszkodowań za opóźnione loty

- 2025-06-20: Polska przeciwna przedłużeniu umowy UE–Ukraina o transporcie drogowym. Uderza ona w krajową branżę transportową

- 2025-06-11: Wiceprzewodniczący PE: Polska prezydencja zapewniła UE stabilność w niepewnych czasach. Wiele inicjatyw dotyczyło obronności

Więcej ważnych informacji

Jedynka Newserii

Jedynka Newserii

Jedynka Newserii

Jedynka Newserii

Ochrona środowiska

Kraje dotknięte powodzią z 2024 roku z dodatkowym wsparciem finansowym. Europosłowie wzywają do budowy w UE lepszego systemu reagowania na kryzysy

W lipcu Parlament Europejski przyjął wniosek o uruchomienie 280,7 mln euro z Funduszu Solidarności UE na wsparcie sześciu krajów dotkniętych niszczycielskimi powodziami w 2024 roku. Polska otrzyma z tego 76 mln euro, a środki mają zostać przeznaczone na naprawę infrastruktury czy miejsc dziedzictwa kulturowego. Nastroje polskich europosłów związane z funduszem są podzielone m.in. w kwestii tempa unijnej interwencji oraz związanej z nią biurokracji. Ich zdaniem w UE potrzebny jest lepszy system reagowania na sytuacje kryzysowe.

Handel

Nestlé w Polsce podsumowuje wpływ na krajową gospodarkę. Firma wygenerowała 0,6 proc. polskiego PKB [DEPESZA]

Działalność Nestlé w Polsce wsparła utrzymanie 45,2 tys. miejsc pracy i wygenerowała 20,1 mld zł wartości dodanej dla krajowej gospodarki. Firma przyczyniła się do zasilenia budżetu państwa kwotą 1,7 mld zł – wynika z „Raportu Wpływu Nestlé” w Polsce przygotowanego przez PwC na podstawie danych za 2023 rok.

Polityka

M. Kobosko: Surowce dziś rządzą światem i zdecydują o tym, kto wygra w XXI wieku. Zasoby Grenlandii w centrum zainteresowania

Duńska prezydencja w Radzie Unii Europejskiej rozpoczęła się 1 lipca pod hasłem „Silna Europa w zmieniającym się świecie”. Według zapowiedzi ma się ona skupiać m.in. na bezpieczeństwie militarnym i zielonej transformacji. Dla obu tych aspektów istotna jest kwestia niezależności w dostępie do surowców krytycznych. W tym kontekście coraz więcej mówi się o Grenlandii, autonomicznym terytorium zależnym Danii, bogatym w surowce naturalne i pierwiastki ziem rzadkich. Z tego właśnie powodu wyspa znalazła się w polu zainteresowania Donalda Trumpa.

Partner serwisu

Szkolenia

Akademia Newserii

Akademia Newserii to projekt, w ramach którego najlepsi polscy dziennikarze biznesowi, giełdowi oraz lifestylowi, a także szkoleniowcy z wieloletnim doświadczeniem dzielą się swoją wiedzą nt. pracy z mediami.

![Nestlé w Polsce podsumowuje wpływ na krajową gospodarkę. Firma wygenerowała 0,6 proc. polskiego PKB [DEPESZA]](https://www.newseria.pl/files/1097841585/fabryka-nesquik_1,w_85,r_png,_small.png)

.gif)

|

| |

| |

|