| Mówi: | Marcin Trepka |

| Funkcja: | partner, radca prawny |

| Firma: | Baker McKenzie |

UE pracuje nad przepisami dotyczącymi sztucznej inteligencji. Część z nich może jednak zahamować jej rozwój

Rozwiązania z obszaru sztucznej inteligencji mogą być szansą na pobudzenie gospodarki i skok technologiczny. Z drugiej strony wiążą się też z zagrożeniami, a w Europie są już przypadki, kiedy algorytmy sztucznej inteligencji były wykorzystywane w sposób budzący wątpliwości prawne. Tymczasem na ten moment nie ma żadnego prawa, które regulowałoby ten obszar. Dlatego UE intensywnie pracuje nad przepisami, które w większości mają mocno prokonsumencki charakter. Partner w kancelarii Baker McKenzie Marcin Trepka wskazuje jednak, że zbyt sztywne przepisy zadziałają odwrotnie i zamiast pobudzić, ograniczą innowacyjność i rozwój sztucznej inteligencji.

– Elementem, który musi zostać uregulowany, jest przewidywalność systemów sztucznej inteligencji. Największe zagrożenie jest dostrzegane właśnie w tym braku przewidywalności, tzn. że algorytm będzie podejmował pewne decyzje w sposób niezamierzony przez tego, który go skonstruował. Systemy, które wiążą się z wysokim ryzykiem, to np. stosowana w medycynie sztuczna ręka chirurga, gdzie SI będzie de facto asystowała w operacji, czy autonomiczne samochody i drony. Tutaj nie może być miejsca na pomyłki – mówi agencji Newseria Biznes Marcin Trepka, radca prawny i partner w kancelarii Baker McKenzie.

Sztuczna inteligencja jest w tej chwili jedną z najszybciej rozwijających się technologii i elementarną częścią cyfrowej transformacji. Według danych przytaczanych przez Komisję Europejską w ostatniej dekadzie liczba zgłoszeń patentowych w zakresie SI wzrosła aż o 400 proc. Szacuje się, że do 2025 roku wpływ tej technologii na gospodarkę będzie liczony w bilionach euro, a dzięki niej w Europie może powstać ok. 60 mln nowych miejsc pracy. Dlatego też KE chce zwiększyć prywatne i publiczne inwestycje w sztuczną inteligencję do 20 mld euro rocznie, a w marcu tego roku Parlament Europejski przyjął projekt europejskiej strategii w zakresie danych, które są podstawą dla rozwoju SI.

Szansę rozwojową w tej technologii dostrzega też rząd, który w styczniu br. przyjął „Politykę dla rozwoju sztucznej inteligencji w Polsce”. Określa ona ponad 200 zadań, których realizacja jest niezbędna do szerokiego wdrożenia SI m.in. w takich obszarach jak edukacja, nauka, sektor przedsiębiorstw i sektor publiczny oraz współpraca międzynarodowa.

Partner w kancelarii Baker McKenzie zauważa, że jednym z problemów we wdrażaniu SI jest jednak brak odpowiednich uregulowań prawnych. Termin „sztuczna inteligencja” jest bardzo pojemny, używany w odniesieniu do wielu różnych rozwiązań technologicznych, z którymi wiążą się też różne ryzyka prawne.

– Mamy bardzo dużą inicjatywę legislacyjną po stronie Komisji Europejskiej. Mamy trzy akty, które są obecnie procedowane. To jest akt o systemach sztucznej inteligencji, akt o usługach cyfrowych i akt o rynkach cyfrowych. One w założeniu na poziomie całej UE mają regulować sektor cyfrowy w zakresie wprowadzania do obrotu i wykorzystywania systemów sztucznej inteligencji. Natomiast poza tym nie ma dziś specyficznej regulacji w tym obszarze – podkreśla radca prawny.

Pomimo braku konkretnych regulacji dotyczących SI do tego obszaru zastosowanie mają przepisy ogólne, prawo cywilne. Autonomiczne działanie sztucznej inteligencji stwarza bowiem szereg wyzwań dotyczących odpowiedzialności prawnej. W tej chwili nie istnieją przepisy regulujące, kto będzie ponosić tę odpowiedzialność np. za wypadek z udziałem autonomicznego samochodu czy decyzje podjęte przez algorytm bez autoryzacji, ale w tych sprawach UE wydała swoje opinie.

– Możemy sobie wyobrazić, że autonomiczny samochód albo dron uszkodzi czyjeś zdrowie czy w skrajnych przypadkach zabije człowieka. Jeśli zdarzy się taki wypadek, kto za to odpowiada? Tu również jest rezolucja Parlamentu Europejskiego przewidująca, że – na zasadzie ryzyka – tę odpowiedzialność ponosi ten, kto z tego rozwiązania korzysta, a na zasadzie dołożenia należytej staranności – ten, który go stworzył. To już jednak trochę inny rodzaj odpowiedzialności – mówi Marcin Trepka.

Z kolei w sprawach gospodarczych zastosowanie znajduje prawo konkurencji i ochrony konsumentów. Zdarzały się już bowiem przypadki, kiedy algorytmy sztucznej inteligencji były wykorzystywane w sposób budzący wątpliwości od strony prawnej.

– Przykładowo bardzo popularne są różnego rodzaju algorytmy monitorujące ceny, dostosowujące je do poziomu konkurencji. Komisja Europejska w 2017 roku – kiedy ogłaszała wyniki bardzo dużego badania sektorowego w zakresie e-commerce – pokazała, że 53 proc. przedsiębiorców działających na rynku monitoruje ceny konkurentów, a 67 proc. robi to z wykorzystaniem specjalnych algorytmów, z czego 78 proc. z nich dostosowuje na tej podstawie swoje ceny. I nagle może się okazać, że mamy ujednolicenie cen w całych sektorach, ponieważ wszyscy dostosowują się do swoich konkurentów. Tu pojawia się zagrożenie dla konkurencji na rynku w postaci tzw. cichej zmowy, która pomimo że w większości jurysdykcji nie jest zabroniona przez przepisy prawa konkurencji, może wywoływać skutki antykonkurencyjne analogiczne do antykonkurencyjnego porozumienia – ostrzega ekspert Baker McKenzie.

Bardzo duży wpływ na kształtowanie praktyk w tym zakresie będzie mieć projekt rozporządzenia w sprawie sztucznej inteligencji (Artificial Intelligence Act), który Komisja Europejska zaprezentowała 21 kwietnia tego roku. Jeszcze przed tym Parlament powołał specjalną Komisję ds. Sztucznej Inteligencji w Erze Cyfrowej (AIDA), której zadaniem jest przeanalizowanie wpływu tej technologii na gospodarkę UE. W październiku ub.r. PE przyjął też trzy sprawozdania dotyczące sposobów na uregulowanie sztucznej inteligencji przez UE, aby wspierać innowacje, standardy etyczne i zaufanie do technologii. Jak wskazali europosłowie, przepisy regulujące ten obszar powinny być ukierunkowane przede wszystkim na człowieka.

– Wszystkie te regulacje są bardzo prokonsumenckie. Zdaniem niektórych obserwatorów ten konsument jest w tym przypadku nawet „nadchroniony”, czyli przyznajemy mu więcej ochrony, niż jest to wymagane. W ten sposób naturalnie ograniczamy innowacyjność, ponieważ im więcej musimy spełnić zasad, tym mniej możliwości eksperymentowania z technologią – mówi Marcin Trepka.

Procedowane obecnie regulacje dotyczące SI mają – jak wskazuje KE – przekształcić Europę w globalne centrum wiarygodnej sztucznej inteligencji. Z jednej strony mają zbudować zaufanie i ograniczyć związane z nią ryzyka, z drugiej – wspierać inwestycje w SI i rozwój tej technologii. Partner w kancelarii Baker McKenzie zauważa jednak, że zbyt sztywne uregulowania zadziałają odwrotnie i ograniczą innowacyjność w tym obszarze.

– Po stronie przedsiębiorstw będzie to oznaczać spore utrudnienia. Po wejściu w życie tych przepisów wprowadzenie systemu SI do obrotu będzie związane z ogromnymi kosztami. Mamy nawet badania niemieckich ośrodków badawczych, które wyliczają, że małe i średnie przedsiębiorstwa chcące zainwestować w system sztucznej inteligencji będą musiały ponieść koszt nawet 400 tys. euro, co będzie kwotą zaporową. Przewiduje się, że koszty związane ze spełnieniem tych wszystkich ograniczeń mogą de facto zablokować rozwój – w przeciwieństwie do zamierzeń projektodawców rozporządzeń, które mają na celu zrównoważony rozwój systemów sztucznej inteligencji – ocenia radca prawny.

Według danych Eurostatu („Artificial intelligence in EU”) obecnie tylko 4 proc. przedsiębiorstw w Polsce i 7 proc. firm europejskich korzysta z systemów sztucznej inteligencji, ale nie ma wątpliwości, że ten odsetek będzie sukcesywnie wzrastać.

Czytaj także

- 2025-07-16: Przedstawienie projektu przez KE oznacza początek dyskusji nad nowym siedmioletnim budżetem. W PE zdania co do jego kształtu są podzielone

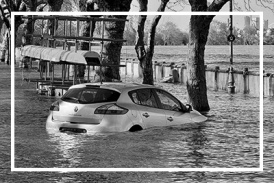

- 2025-07-25: Kraje dotknięte powodzią z 2024 roku z dodatkowym wsparciem finansowym. Europosłowie wzywają do budowy w UE lepszego systemu reagowania na kryzysy

- 2025-07-21: Zbliża się szczyt UE–Chiny. Głównym tematem spotkania będzie polityka handlowa, w tym cła

- 2025-07-17: Unia Europejska wzmacnia ochronę najmłodszych. Parlament Europejski chce, by test praw dziecka był nowym standardem w legislacji

- 2025-07-14: Parlament Europejski wzywa do większej ochrony wolności dziennikarzy. Wiceprzewodnicząca: media mają pełnić funkcję kontrolną, a niektórym rządom to się nie podoba

- 2025-07-22: Przemysł chemiczny czeka na szczegóły unijnego wsparcia dla sektora. Najważniejsza jest obniżka cen energii

- 2025-07-18: KE proponuje nowy Fundusz Konkurencyjności. Ma pobudzić inwestycje w strategiczne dla Europy technologie

- 2025-07-15: Konkurencyjność firm wśród najważniejszych zadań dla kolejnego budżetu UE. Komisja szuka nowych źródeł dochodów

- 2025-07-02: Unijne mechanizmy ułatwiają zwiększenie wydatków na obronność przez europejskie kraje NATO. Ważnym aspektem infrastruktura podwójnego zastosowania

- 2025-07-03: Grzyby rozkładające tekstylia nagrodzone w konkursie ING. 1 mln zł trafi na innowacyjne projekty dla zrównoważonych miast

Więcej ważnych informacji

Jedynka Newserii

Jedynka Newserii

Jedynka Newserii

Jedynka Newserii

Ochrona środowiska

Kraje dotknięte powodzią z 2024 roku z dodatkowym wsparciem finansowym. Europosłowie wzywają do budowy w UE lepszego systemu reagowania na kryzysy

W lipcu Parlament Europejski przyjął wniosek o uruchomienie 280,7 mln euro z Funduszu Solidarności UE na wsparcie sześciu krajów dotkniętych niszczycielskimi powodziami w 2024 roku. Polska otrzyma z tego 76 mln euro, a środki mają zostać przeznaczone na naprawę infrastruktury czy miejsc dziedzictwa kulturowego. Nastroje polskich europosłów związane z funduszem są podzielone m.in. w kwestii tempa unijnej interwencji oraz związanej z nią biurokracji. Ich zdaniem w UE potrzebny jest lepszy system reagowania na sytuacje kryzysowe.

Handel

Nestlé w Polsce podsumowuje wpływ na krajową gospodarkę. Firma wygenerowała 0,6 proc. polskiego PKB [DEPESZA]

Działalność Nestlé w Polsce wsparła utrzymanie 45,2 tys. miejsc pracy i wygenerowała 20,1 mld zł wartości dodanej dla krajowej gospodarki. Firma przyczyniła się do zasilenia budżetu państwa kwotą 1,7 mld zł – wynika z „Raportu Wpływu Nestlé” w Polsce przygotowanego przez PwC na podstawie danych za 2023 rok.

Polityka

M. Kobosko: Surowce dziś rządzą światem i zdecydują o tym, kto wygra w XXI wieku. Zasoby Grenlandii w centrum zainteresowania

Duńska prezydencja w Radzie Unii Europejskiej rozpoczęła się 1 lipca pod hasłem „Silna Europa w zmieniającym się świecie”. Według zapowiedzi ma się ona skupiać m.in. na bezpieczeństwie militarnym i zielonej transformacji. Dla obu tych aspektów istotna jest kwestia niezależności w dostępie do surowców krytycznych. W tym kontekście coraz więcej mówi się o Grenlandii, autonomicznym terytorium zależnym Danii, bogatym w surowce naturalne i pierwiastki ziem rzadkich. Z tego właśnie powodu wyspa znalazła się w polu zainteresowania Donalda Trumpa.

Partner serwisu

Szkolenia

Akademia Newserii

Akademia Newserii to projekt, w ramach którego najlepsi polscy dziennikarze biznesowi, giełdowi oraz lifestylowi, a także szkoleniowcy z wieloletnim doświadczeniem dzielą się swoją wiedzą nt. pracy z mediami.

![Nestlé w Polsce podsumowuje wpływ na krajową gospodarkę. Firma wygenerowała 0,6 proc. polskiego PKB [DEPESZA]](https://www.newseria.pl/files/1097841585/fabryka-nesquik_1,w_85,r_png,_small.png)

.gif)

|

| |

| |

|